Come creare file robots txt WordPress e ottimizzarlo per la SEO

La SEO è una priorità assoluta per i proprietari di siti web. Con i primi cinque risultati che guadagnano il 75% dei clic la corsa per un posizionamento più alto è sempre una sfida. Esistono varie tecniche SEO off-page e on-page che entrano in gioco; l’ottimizzazione del file Robot.txt è uno di quei trucchi che possono rafforzare la SEO del vostro sito.

Tuttavia la maggior parte dei principianti non sa come ottimizzare il file Robots.txt di WordPress per la SEO. Alcuni potrebbero anche non sapere cosa sia un file robots.txt.

Per fortuna, questo articolo ti viene in soccorso.

Qui spiego cos’è un file robots.txt, come creare il file robots.txt WordPress e come ottimizzare il file robots.txt per la SEO. Verso la fine ho anche aggiunto alcune FAQ che credo possano aiutarti.

Ok, iniziamo!

Che cos’è un file Robots.txt ?

Il file Robots.txt in WordPress è un file di testo semplice che indica ai bot dei motori di ricerca quali pagine del vostro sito devono essere scansionate e indicizzate. È anche possibile formattare il file per escludere le pagine dall’indicizzazione.

Il robots.txt si trova nella directory principale di WordPress. Questo file ha un formato di base che assomiglia a questo:

User-agent: [user-name]

Disallow: [string URL che non vogliamo far scansionare]

Allow: [stringa URL che vogliamo sia scansionabile]

Sitemap: [URL della sitemap XML WordPress XML]

Un esempio di come dovrebbe essere un file Robots.txt ?

Un file robots.txt è semplicemente qualche riga di testo che indirizza i motori di ricerca su come e cosa effettuare il crawling del vostro sito. In questo file sono presenti più righe per consentire o limitare URL di pagine specifiche. È anche possibile aggiungere sitemap multiple. Se non si consente un URL, i bot dei motori di ricerca non effettuano il crawling di quella pagina.

Ecco un esempio di file robots.txt:

User-Agent: *

Allow: /wp-content/uploads/

Disallow: /wp-content/plugins/

Sitemap: https://URL/sitemap_index.xml

Vediamo ora di conoscere i quattro termini principali che si possono trovare in un file robots:

- User-agent: L’user agent è il web crawler specifico a cui si danno istruzioni di crawling. Di solito si tratta di un motore di ricerca.

- Allow: Allow è il comando che indica a Googlebot che può accedere a una pagina o a una sottocartella anche se la sua sottocartella o una pagina madre potrebbero essere non consentite.

- Disallow: Il comando disallow indica a un user-agent di non eseguire il crawling di un determinato URL. È possibile includere una sola riga “Disallow:” per ogni URL.

- Sitemap: La sitemap viene utilizzata per richiamare la posizione di qualsiasi sitemap XML correlata a questo URL. Questo comando è supportato solo da Google, Bing, Ask e Yahoo.

Nell’esempio precedente, abbiamo permesso ai bot di ricerca di scansionare e indicizzare la cartella uploads, ma abbiamo limitato la cartella plugins, infine abbiamo permesso l’indicizzazione della sitemap XML.

Il segno dell’asterisco dopo User-Agent significa che il testo si applica a tutti i bot dei motori di ricerca, ogni motore di ricerca ha il suo user agent per indicizzare i siti. Ecco alcuni user-agent di alcuni popolari motori di ricerca:

- Google: Googlebot

- Immagini Googlebot: Immagine Googlebot

- Notizie su Googlebot: Notizie su Googlebot

- Video Googlebot

- Yahoo: Bot a scorrimento

- Bing: Bingbot

- Alexa di Amazon: ia_archiver

- DuckDuckGo: DuckDuckBot

- Yandex: YandexBot

- Baidu: Baiduspider

- Exalead: ExaBot

Al giorno d’oggi esistono tantissimi user-agent. Se volete concentrarvi su un particolare motore di ricerca, potete anche specificarlo nel file robots.txt. Ad esempio, per impostare le istruzioni per Googlebot, si può scrivere la prima riga del file robots.txt come segue:

User-agent: Googlebot

Perché è necessario un file Robots.txt in WordPress ?

I bot di ricerca effettuano il crawling e l’indicizzazione del vostro sito anche se non avete un file robots.txt. Quindi, perché ne avete bisogno? Con il file robots.txt è possibile indicare ai motori di ricerca di dare priorità all’indicizzazione di determinate pagine. Inoltre, è possibile escludere pagine o cartelle che non si desidera indicizzare.

Questo non ha un impatto maggiore quando si inizia a un blog e non si hanno molti contenuti. Tuttavia, dopo la crescita del sito e la presenza di molti contenuti, potrebbe essere necessario dare priorità all’indicizzazione di una determinata pagina/post/cartella e negarne altre.

Esiste una quota per ogni bot di ricerca per ogni sito web. Ciò significa che i bot effettuano il crawling di un certo numero di pagine in una determinata sessione di crawling. Se i bot non terminano il crawling in quella particolare sessione, il bot torna indietro e riprende il crawling nella sessione successiva. Questo rallenta il tasso di indicizzazione del sito web.

Pertanto, utilizzando il file robots.txt, è possibile indirizzare i bot di ricerca su quali pagine, file e cartelle si desidera indicizzare e quali includere. In questo modo, si risparmia la quota di crawl. Forse non è il modo più sicuro per nascondere i contenuti al pubblico, ma impedisce che i contenuti esclusi appaiano nelle SERP.

Come creare un file Robots txt WordPress per il tuo sito web ?

È possibile creare il file robots.txt in due modi diversi. Di seguito illustreremo questi metodi. Potete quindi seguire il metodo che ritenete più adatto a voi.

Metodo 1: Creazione del file Robots.txt con il plugin Yoast SEO

Yoast SEO è un plugin per la SEO di WordPress che semplifica l’ottimizzazione dei contenuti del sito web con suggerimenti integrati basati sulle migliori pratiche ampiamente accettate. Utilizzando questo pratico strumento, è possibile personalizzare facilmente importanti impostazioni SEO e controllare quali pagine sono indicizzabili.

Per creare un file robots.txt utilizzando il plugin Yoast SEO, bisogna per prima cosa installare il plugin, quindi vai alla sezione Plugin -> Aggiungi nuovo

Nel box in alto a destra ricerca il plugin Yoast SEO, installalo e attivalo.

In realtà il file robots.txt è già presente all’interno dello spazio web del sito web ma attraverso l’utilizzo del plugin Yoast anche un principiante può inserire le specifiche in modo facilissimo.

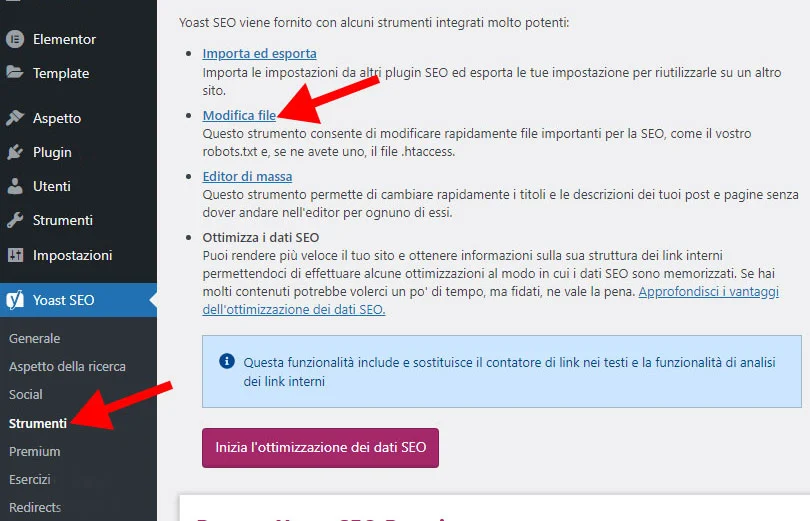

A questo punto sulla barra dei comandi di sinistra sotto alla sezione del plugin Yoast SEO appena installato clicca su “Strumenti” e poi clicca su “Modifica file”.

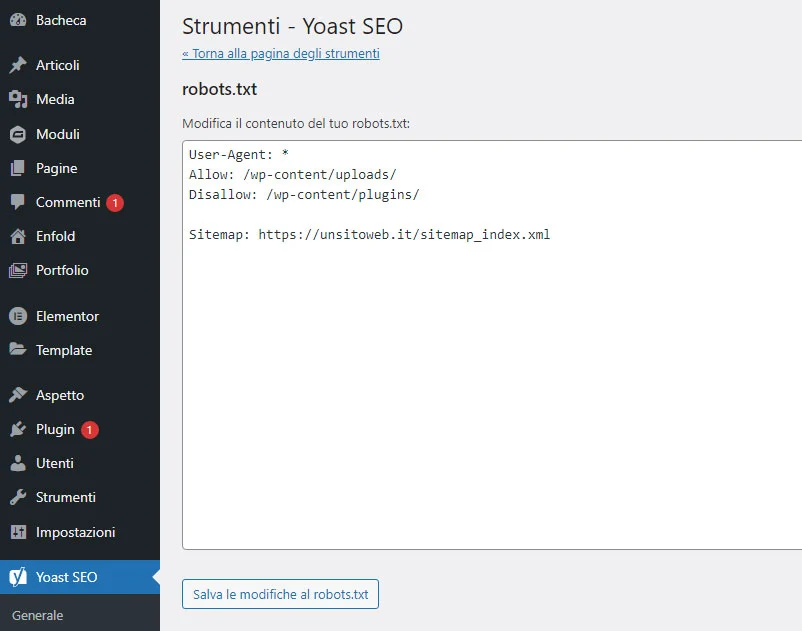

Alla schermata successiva il primo box bianco che vedrai è quello dove inserire le specifiche del file robots.txt

A questo punto, inserire il seguente codice che è lo stesso citato nell’esempio precedente

User-Agent: *

Allow: /wp-content/uploads/

Disallow: /wp-content/plugins/

Sitemap: https://unsitoweb.it/sitemap_index.xml

Mi raccomando di sostituire il link del mio sito web unsitoweb.it con il vostro.

Metodo 2: Creare file Robots txt WordPress manualmente.

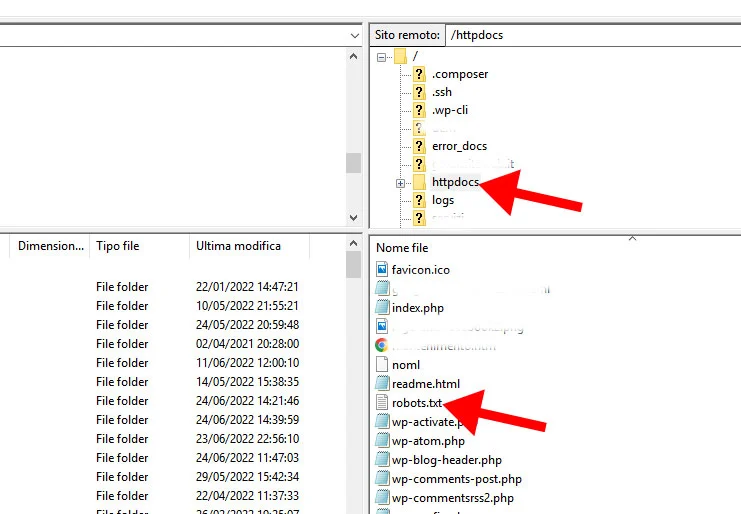

Il secondo metodo prevede di creare il file robots txt manualmente per poi sostituire quello presente tramite un programma FTP oppure direttamente dal file manager del pannello di controllo del tuo servizio di Hosting

Se sei un po’ pratico, invece di creare il file robots txt da zero, puoi scaricare quello presente all’interno del tuo spazione web nella cartella principale (Root) che di solito si chiama “public_html” o anche “httpdocs”

Ma più semplicemente apri il bloc note di windows, inserisci le specifiche per il file robotx txt e salva il file con il nome di “robots.txt”.

Una volta fatto non ti resta, come detto prima, sovrascrivere quello presente nella root dello spazio web del tuo sito.

Dove inserire il file Robots.txt ?

Il file robots.txt va sempre inserito nella directory principale del sito web. Ad esempio, se il sito è miosito.com, il link del file robots.txt sarà https://miosito.com/robots.txt.

Oltre ad aggiungere il file robots.txt nella directory principale, ecco alcuni suggerimenti aggiuntivi:

- È d’obbligo nominare il file “robots.txt“.

- Il nome del file è sensibile alle maiuscole. Pertanto, è necessario che il nome sia corretto, altrimenti non funzionerà.

- È necessario aggiungere una nuova riga per ogni nuova regola.

- Utilizzare ogni user-agent solo una volta.

Come testare il file Robots.txt ?

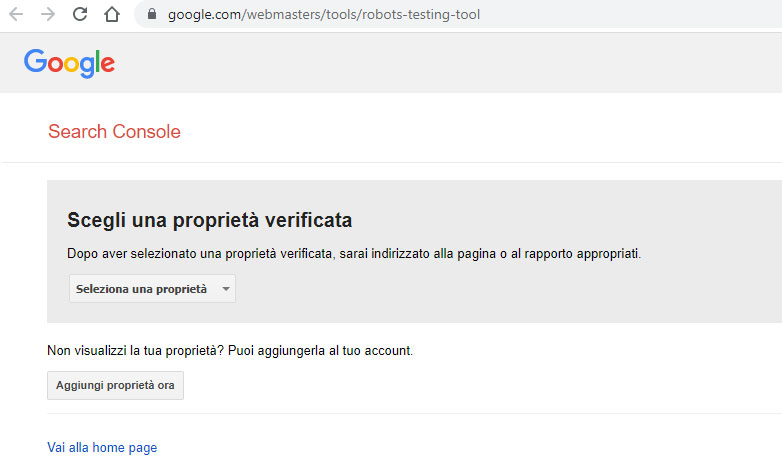

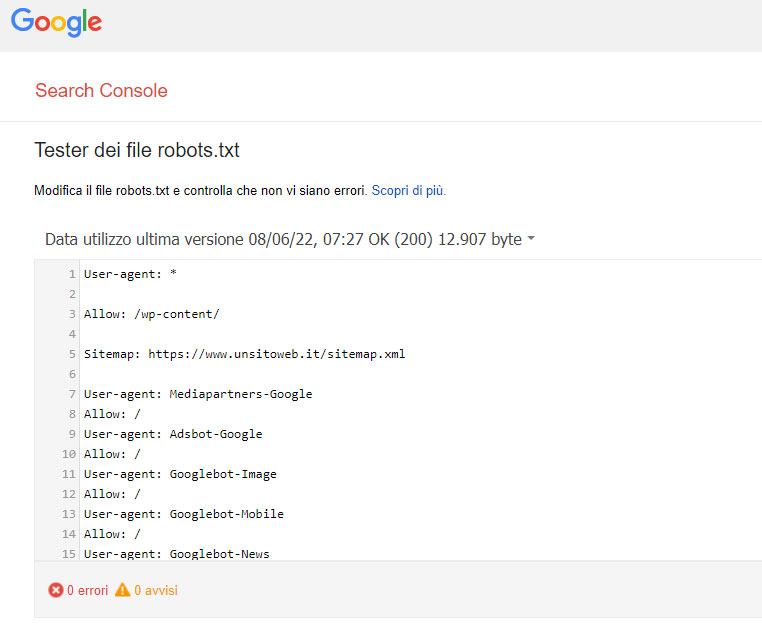

Dopo aver creato il file robots.txt, è possibile testarlo utilizzando la Google Search Console. Qui trovi lo strumento Open robots.txt tester.

Seleziona la proprietà dall’elenco a discesa fornito.

Lo strumento recupera il file robots.txt del vostro sito ed evidenzia gli errori e gli avvertimenti se ne trova qualcuno.

I vantaggi del file Robots.txt di WordPress

Ecco i vantaggi dell’utilizzo del file Robots.txt in ambito SEO:

- Aiuta a ottimizzare i budget di crawl del motore di ricerca, saltando l’indicizzazione delle pagine che non si vuole che i bot effettuino il crawling. In questo modo si crea una priorità per il motore di ricerca, che deve scansionare solo le pagine importanti per l’utente.

- Aiuta a ottimizzare il server web limitando i bot che consumano inutilmente risorse.

- Aiuta a nascondere le pagine di accesso, le pagine di destinazione e le pagine di ringraziamento dall’indicizzazione dei motori di ricerca. In questo modo, ottimizza le prestazioni del sito web.

Contro del file robots.txt

- Creare un file robots.txt è piuttosto semplice, come abbiamo spiegato sopra. Tuttavia, il file robots.txt include anche gli URL delle pagine interne che non si desidera far indicizzare ai bot di crawling, come la pagina di login. Questo rende il vostro sito web vulnerabile alle violazioni della sicurezza.

- Sebbene creare un file robots.txt sia facile, anche un semplice errore può vanificare tutti i vostri sforzi. Ad esempio, se si aggiunge o si sbaglia un singolo carattere nel file, si vanificano tutti gli sforzi SEO.

Domande frequenti (FAQ)

Che cos’è il web crawling?

I motori di ricerca inviano i loro web crawler (noti anche come bot o spider) attraverso il web. Questi bot sono software intelligenti che navigano nell’intero web per scoprire nuove pagine, link e siti web. Questo processo di scoperta è noto come web crawling.

Che cos’è l’indicizzazione?

Quando i web crawler scoprono il vostro sito, organizzano le vostre pagine in una struttura di dati utilizzabile, questo processo di organizzazione si chiama indicizzazione.

Qual è il budget per le strisciate?

Il budget di crawl è un limite al numero di URL che un bot di ricerca può crawlare in una determinata sessione. Ogni sito ha un budget di crawl specifico. È quindi necessario assicurarsi di spenderlo nel modo più vantaggioso per il sito.

Ad esempio, se il sito contiene più pagine, è necessario allocare il budget per il crawling alle pagine di maggior valore. Pertanto, è possibile indicare l’URL della pagina nel file robots.txt.

Conclusione

Quando si lavora sulla SEO di un sito web, la maggior parte degli utenti si concentra sulla creazione di sitemap, sulla creazione di backlink, sulla ricerca di parole chiave e sull’ottimizzazione dei contenuti. Solo pochi webmaster prestano attenzione al file robots.txt.

Il file robots.txt può non avere molta importanza quando si avvia un sito. Tuttavia, man mano che il sito cresce, prestare attenzione al file robots.txt consente di ottenere risultati migliori.

Inoltre, esiste il mito che il blocco delle categorie, delle pagine di archivio e dei tag aumenti la velocità di crawl e favorisca un’indicizzazione più rapida. È falso.

Seguite i metodi indicati sopra per creare il file robots.txt WordPress

Speriamo che questo articolo vi abbia aiutato a risolvere la vostra domanda su come creare il file robots.txt di WordPress e ottimizzarlo per la SEO.

Lascia un Commento

Vuoi partecipare alla discussione?Sentitevi liberi di contribuire!